Tutorial: Erstellen eines KI-Workflows in n8n

Erstellen eines KI-Chat-Agents mit n8n

Willkommen zum Einführungstutorial für KI-Workflows in n8n! Unabhängig davon, ob du bereits Erfahrung mit n8n hast oder nicht – dieses Tutorial führt dich durch die grundlegenden Bausteine von KI-Workflows und hilft dir, einen voll funktionsfähigen KI-Chat-Agenten zu erstellen, den du leicht an deine eigenen Anforderungen anpassen kannst.

Viele Menschen lernen neue Inhalte am besten über Videos. Dieses Tutorial basiert auf einem beliebten Video von n8n – den Link findest du unten. Du kannst das Video anschauen, das Tutorial lesen oder beides kombinieren!

Was du benötigst

- n8n: Für dieses Tutorial empfehlen wir den Einsatz von n8n Cloud – neue Nutzer erhalten eine kostenlose Testphase! Wenn du lieber selbst hosten möchtest, schau dir die Installationsseite an.

- Anmeldedaten für ein Chat-Modell: In diesem Tutorial verwenden wir OpenAI, aber du kannst problemlos auf DeepSeek, Google Gemini, Groq, Azure oder andere Anbieter umsteigen (weitere Optionen findest du in der Dokumentation der jeweiligen Knoten).

Was du lernen wirst

- KI-Konzepte in n8n

- Verwendung des AI Agent-Knotens

- Verarbeitung von Chat-Eingaben

- Anbindung eines KI-Modells

- Anpassung des Prompts

- Beobachtung des Gesprächsverlaufs

- Hinzufügen von persistentem Kontext (Gedächtnis)

KI-Konzepte in n8n

Wenn du bereits mit KI vertraut bist, kannst du diesen Abschnitt überspringen. Hier erhältst du eine grundlegende Einführung in KI-Konzepte und deren Anwendung in n8n-Workflows.

KI-Agenten bauen auf sogenannten Large Language Models (LLMs) auf. LLMs generieren Text, indem sie das nächste Wort auf Basis der Eingabe vorhersagen. Ein LLM verarbeitet lediglich die Eingabe und erzeugt eine Ausgabe. Ein KI-Agent hingegen verfolgt zielgerichtete Aufgaben. Er kann Werkzeuge nutzen, seine eigene Ausgabe analysieren und darauf basierend Entscheidungen treffen, um komplexe Aufgaben zu lösen.

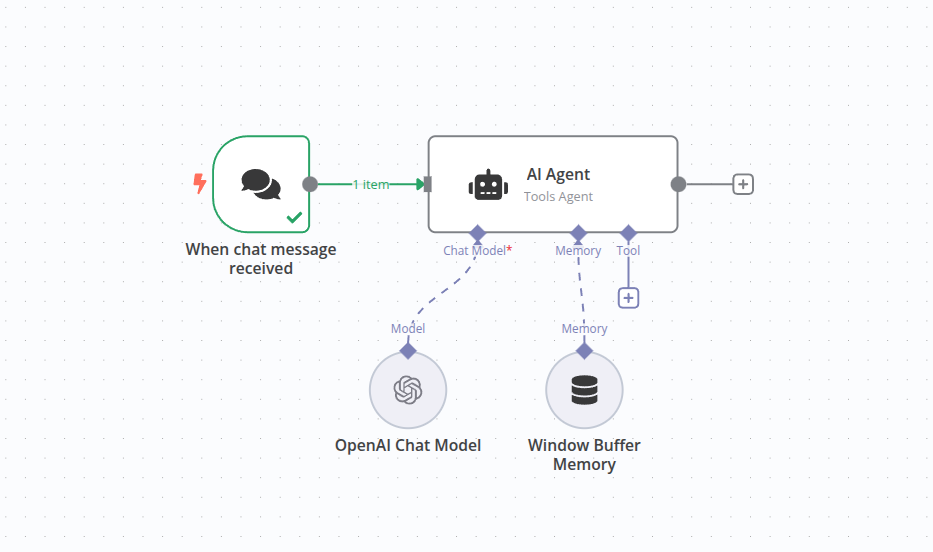

In n8n wird ein KI-Agent als Knoten mit zusätzlichen Verbindungen dargestellt.

| Funktion | LLM | KI-Agent |

|---|---|---|

| Kernkompetenz | Textgenerierung | Zielgerichtete Aufgabenerfüllung |

| Entscheidungsfähigkeit | Nein | Ja |

| Werkzeug-/API-Aufrufe | Nicht unterstützt | Unterstützt |

| Workflow-Komplexität | Einzelschritt | Mehrschrittig |

| Anwendungsbereich | Sprachgenerierung | Lösung komplexer realer Aufgaben |

| Beispiel | LLM generiert einen Textabschnitt | Agent plant automatisch ein Meeting |

Durch die Einbettung von KI-Agenten als Knoten ermöglicht n8n die Kombination KI-gesteuerter Schritte mit klassischer Programmierung, um effiziente reale Workflows zu erstellen. Einfache Aufgaben wie die Validierung einer E-Mail-Adresse benötigen keine KI – hier kommen traditionelle Methoden zum Einsatz. Komplexe Aufgaben wie die Analyse des Inhalts einer E-Mail oder die Verarbeitung multimodaler Eingaben (z. B. Bilder, Audio) sind hingegen ideal für KI-Agenten geeignet.

1. Erstellen eines neuen Workflows

Beim Öffnen von n8n siehst du eine der folgenden Ansichten:

- Leerer Workflow: Falls du zum ersten Mal angemeldet bist und noch keine Workflows hast, kannst du direkt diesen leeren Workflow verwenden.

- Workflow-Liste (auf der Übersichtsseite): Klicke auf die

-Schaltfläche, um einen neuen Workflow zu erstellen.

-Schaltfläche, um einen neuen Workflow zu erstellen.

2. Hinzufügen eines Trigger-Knotens

Jeder Workflow benötigt einen Startpunkt. In n8n werden diese Startpunkte als Trigger-Knoten bezeichnet. Für diesen Workflow beginnen wir mit einem Chat-Knoten.

-

Klicke auf Ersten Schritt hinzufügen oder drücke die

Tab-Taste, um das Knoten-Suchmenü zu öffnen. -

Suche nach Chat Trigger. n8n zeigt eine Liste passender Knoten an.

-

Wähle Chat Trigger, um den Knoten zur Arbeitsfläche hinzuzufügen. n8n öffnet automatisch die Knotenansicht.

-

Schließe die Knotenansicht (klicke auf Zurück zum Canvas), um zur Canvas-Ansicht zurückzukehren.

Mehr über den Chat-Trigger-Knoten...

Trigger-Knoten erzeugen eine Ausgabe, sobald ein bestimmtes Ereignis eintritt. In diesem Tutorial möchten wir den Workflow durch Texteingabe auslösen. In Produktionsumgebungen kann dieser Trigger mit der öffentlichen Chat-Oberfläche von n8n verbunden oder in andere Webseiten eingebettet werden. Der Einfachheit halber verwenden wir hier die integrierte lokale Chat-Oberfläche – ohne zusätzliche Konfiguration.

Workflow-Datei anzeigen

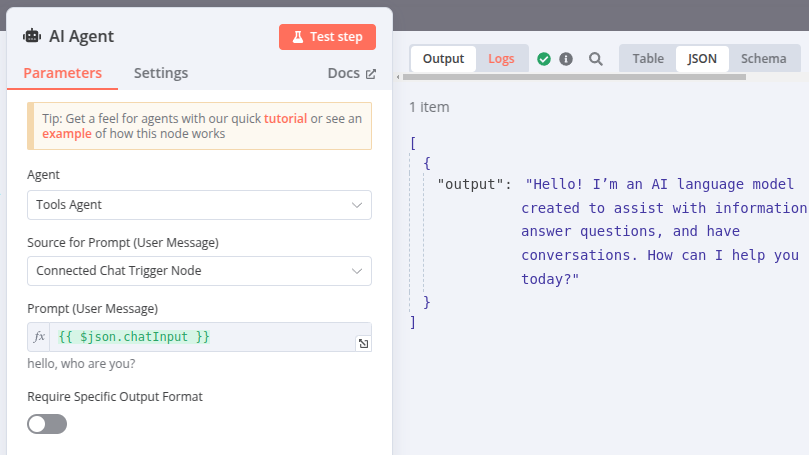

3. Hinzufügen des AI Agent-Knotens

Der AI Agent-Knoten ist das Herzstück jedes KI-fähigen Workflows in n8n.

-

Klicke auf den Add node-Button („Knoten hinzufügen“)

am Ausgang des Trigger-Knotens, um die Knotensuche zu öffnen.

am Ausgang des Trigger-Knotens, um die Knotensuche zu öffnen. -

Gib „AI“ ein und wähle den AI Agent-Knoten aus, um ihn zum Workflow hinzuzufügen.

-

Die Bearbeitungsansicht des AI Agent-Knotens wird geöffnet.

-

Es gibt einige Felder, die du anpassen kannst. Da wir den Chat Trigger-Knoten verwenden, sind die Standardeinstellungen für die Prompt-Quelle und -Spezifikation bereits korrekt und müssen nicht geändert werden.

Workflow-Datei anzeigen

4. Konfiguration der Knoten

Der AI Agent benötigt ein Chat-Modell, um eingehende Prompts zu verarbeiten.

-

Klicke auf das Plus-Symbol

am unteren Rand des AI Agent-Knotens (erste Verbindung „Chat Model“), um ein Chat-Modell hinzuzufügen.

am unteren Rand des AI Agent-Knotens (erste Verbindung „Chat Model“), um ein Chat-Modell hinzuzufügen. -

Das Suchfeld zeigt nun alle in n8n integrierten Sprachmodelle an. In diesem Tutorial verwenden wir das OpenAI Chat Model.

-

Wähle OpenAI Chat Model aus der Liste aus. Es wird automatisch mit dem AI Agent-Knoten verbunden und der Knoteneditor geöffnet. Einer der Parameter, den du ändern kannst, ist das „Modell“. Beachte: Mit einem kostenlosen OpenAI-Basisaccount steht dir nur das Modell

gpt-4o-minizur Verfügung.

Welches Chat-Modell soll ich wählen?

Wie bereits erwähnt, ist ein LLM die Komponente, die auf Basis eines gegebenen Prompts Text generiert. Die Entwicklung und das Training von LLMs ist meist sehr ressourcenintensiv. Unterschiedliche LLMs können je nach Trainingsdaten unterschiedliche Fähigkeiten oder Spezialisierungen aufweisen.

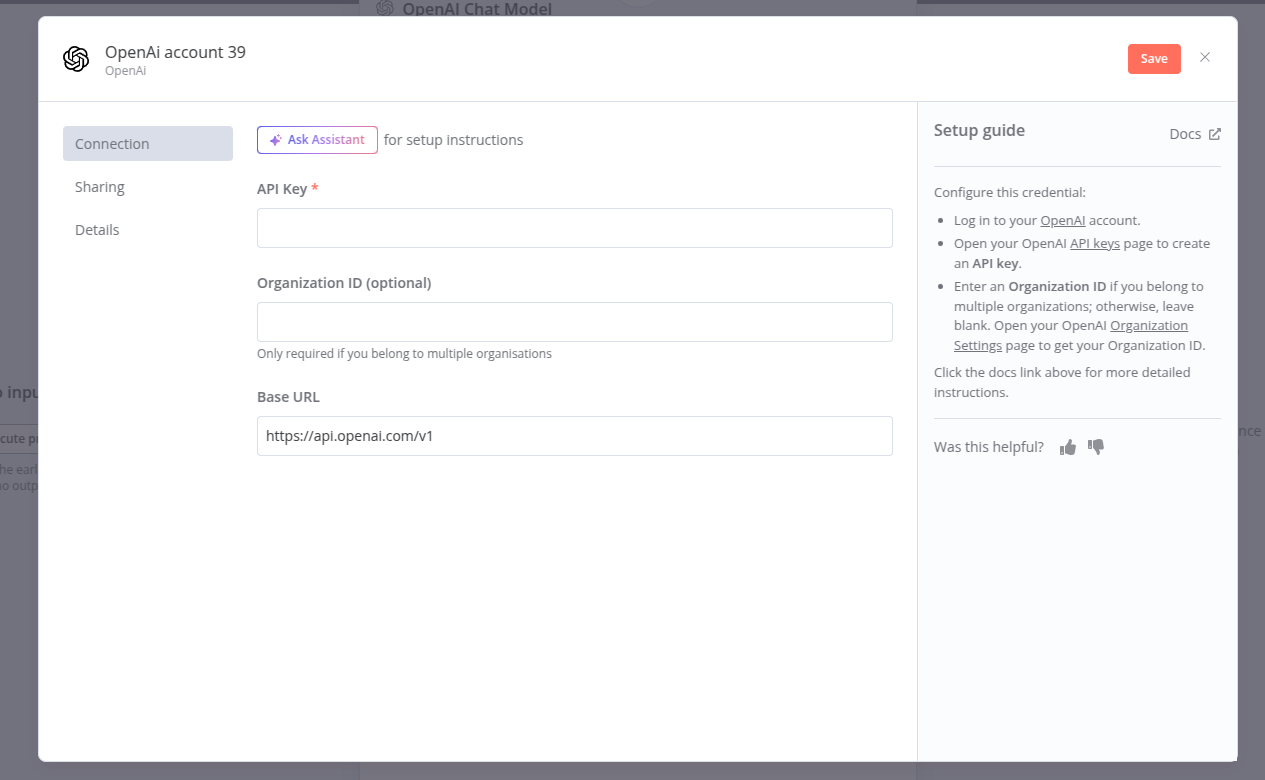

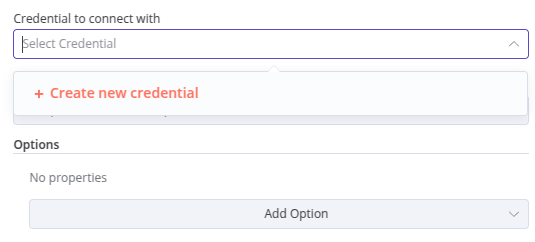

5. Hinzufügen von Anmeldedaten (falls erforderlich)

Damit n8n mit dem Chat-Modell kommunizieren kann, musst du entsprechende Anmeldedaten konfigurieren (d. h. Zugangsdaten für externe Online-Dienste). Wenn du bereits Anmeldedaten für OpenAI eingerichtet hast, sollten diese standardmäßig im Anmeldedaten-Auswahlfeld erscheinen. Andernfalls kannst du über den Auswahlbereich neue Anmeldedaten hinzufügen.

-

Um neue Anmeldedaten hinzuzufügen, klicke auf den Text „Anmeldedaten auswählen“. Es erscheint die Option, neue Anmeldedaten zu erstellen.

-

Für diese Anmeldedaten wird nur ein API-Schlüssel benötigt. Achte beim Hinzufügen jeglicher Art von Anmeldedaten stets auf den Hilfetext auf der rechten Seite. In diesem Fall gibt es einen praktischen Link, der dich direkt zu deinem OpenAI-Konto führt, um den API-Schlüssel zu erhalten.

-

Der API-Schlüssel ist einfach eine lange Zeichenkette – das ist alles, was für diese Anmeldedaten benötigt wird. Kopiere ihn von der OpenAI-Website und füge ihn in das Feld API key ein.

Schütze deine Anmeldedaten

Anmeldedaten sind vertrauliche Informationen, die von Anwendungen oder Diensten ausgestellt werden, um deine Identität zu bestätigen. Sie ermöglichen es n8n-Knoten, sich mit externen Diensten zu verbinden und Daten auszutauschen. Die erforderlichen Informationen variieren je nach Anbieter. Teile diese Anmeldedaten niemals außerhalb von n8n weiter oder veröffentliche sie.

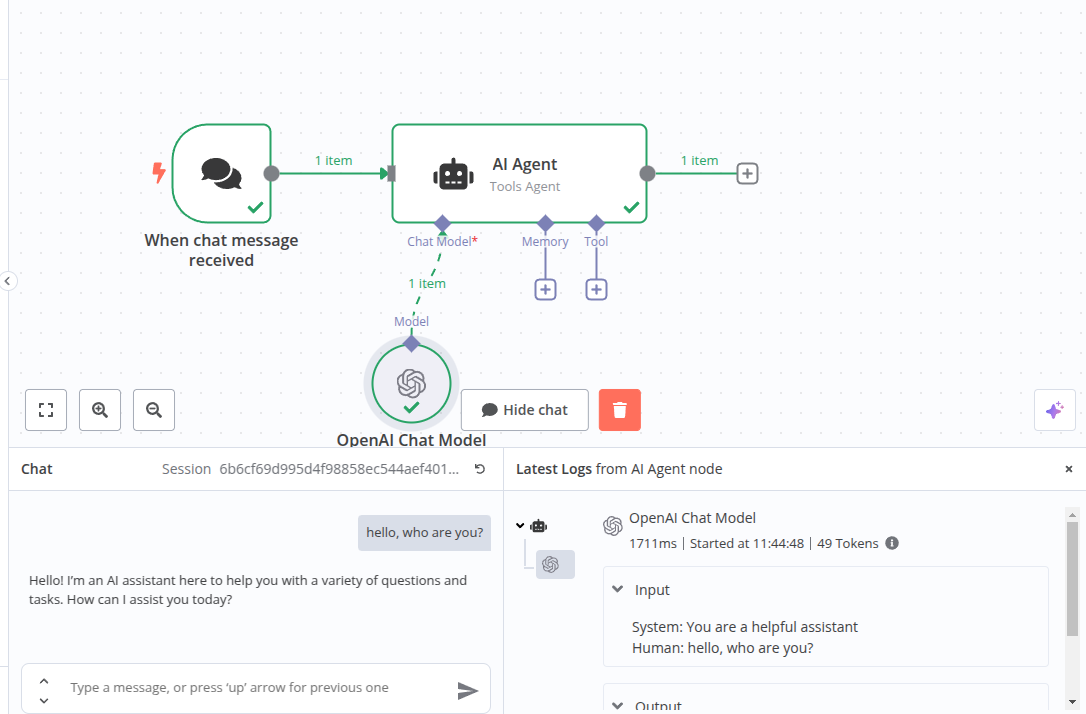

6. Testen der Knoten

Jetzt, da die Knoten mit dem Chat Trigger und dem Chat-Modell verbunden sind, können wir diesen Teil des Workflows testen.

-

Klicke auf die Schaltfläche Chat unten auf der Arbeitsfläche. Links öffnet sich das lokale Chat-Fenster, rechts werden die Logs des AI Agent angezeigt.

-

Gib eine Nachricht ein und drücke

Enter. Die Antwort des Chat-Modells erscheint unter deiner Nachricht. -

Im Log-Fenster siehst du Ein- und Ausgaben des AI Agent.

Logs anzeigen...

Auch ohne die Chat-Oberfläche kannst du auf die Logs des KI-Knotens zugreifen. Öffne dazu den AI Agent-Knoten und klicke im rechten Bereich auf den Reiter Logs.

7. Anpassen des Prompts

-

Öffne den AI Agent-Knoten. Unten im Bedienfeld findest du einen Bereich „Optionen“ und einen Auswahlbereich „Option hinzufügen“. Wähle hier System message (Systemnachricht) aus.

-

Die Systemnachricht wird nun angezeigt. Dies ist derselbe initiale Prompt, den du bereits in den Logs gesehen hast. Ändere den Text, damit das Chat-Modell anders antwortet. Du könntest z. B. schreiben: „Du bist ein begnadeter Dichter und antwortest stets in gereimten Versen.“

-

Schließe den Knoten und kehre zum Chat-Fenster zurück. Wiederhole deine vorherige Nachricht und beobachte, wie sich die Ausgabe verändert.

8. Hinzufügen von Gedächtnis

Das Chat-Modell liefert nun nützliche Antworten – doch bei längeren Gesprächen zeigt sich ein Problem:

-

Sage im Chat z. B.: „Hallo, ich heiße Xiao Ming.“

-

Warte auf die Antwort und frage dann: „Wie heiße ich?“

Der AI Agent kann dir nicht antworten – egal, wie höflich er sich entschuldigt. Der Grund: Der Kontext des Gesprächs wird nicht gespeichert; der Agent hat kein Gedächtnis. -

Damit sich der Agent an frühere Aussagen erinnern kann, muss der Gesprächskontext gespeichert werden. Dies erreichen wir, indem wir dem AI Agent-Knoten ein Gedächtnis hinzufügen. Klicke dazu auf der Arbeitsfläche auf die Schaltfläche Memory (Gedächtnis)

am unteren Rand des AI Agent-Knotens.

am unteren Rand des AI Agent-Knotens. -

Wähle im erscheinenden Panel Simple Memory (Einfaches Gedächtnis). Dies nutzt den Arbeitsspeicher der n8n-Instanz und reicht für einfache Anwendungsfälle normalerweise aus. Der Standardwert von 5 Interaktionen sollte genügen – merke dir jedoch diesen Ort, falls du die Einstellung später anpassen möchtest.

-

Wiederhole das obige Gespräch – du wirst feststellen, dass der AI Agent sich nun an deinen Namen erinnert.

9. Speichern des Workflows

Bevor du den Workflow-Editor verlässt, speichere unbedingt deinen Workflow, sonst gehen alle Änderungen verloren.

- Klicke oben rechts im Editor-Fenster auf die Schaltfläche Speichern. Dein Workflow wird gespeichert und du kannst jederzeit zurückkehren, um weiterzuchatten oder neue Funktionen hinzuzufügen.

Glückwunsch!

Du hast den ersten Schritt zur Erstellung praktischer und effizienter KI-Workflows gemeistert! In diesem Tutorial hast du die grundlegenden Bausteine kennengelernt, den AI Agent-Knoten und ein Chat-Modell hinzugefügt, den Prompt angepasst, um die gewünschte Ausgabe zu erhalten, und Gedächtnis hinzugefügt, damit der Chat den Kontext über mehrere Nachrichten hinweg behält.

Workflow-Datei anzeigen

Nächste Schritte

Da du nun weißt, wie man grundlegende KI-Workflows erstellt, findest du hier weitere Ressourcen, um dein Wissen zu vertiefen, sowie viele Beispiele zur Inspiration:

- Erfahre mehr über KI-Konzepte und sieh dir Beispiele im Bereich Beispiele & Konzepte an.

- Durchsuche die KI-Workflow-Vorlagen.

- Lerne, wie du KI-Agenten mit Werkzeugen erweitern kannst.